网络安全、数字安全是托起数字经济的底层逻辑,不能建立在侵害消费者知情权与选择权的基础上。算法开关给了消费者选择权,还应进一步保障消费者知情权。数据收集透明、规范,不仅是对消费者的保护,更是对企业自身的一种保护。

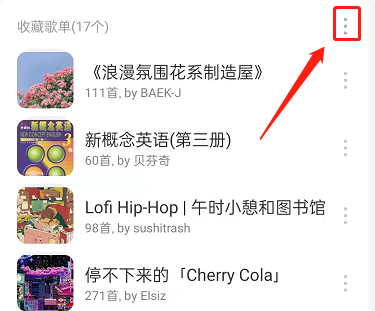

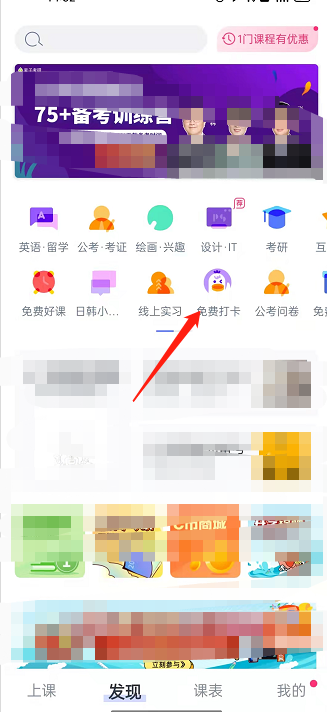

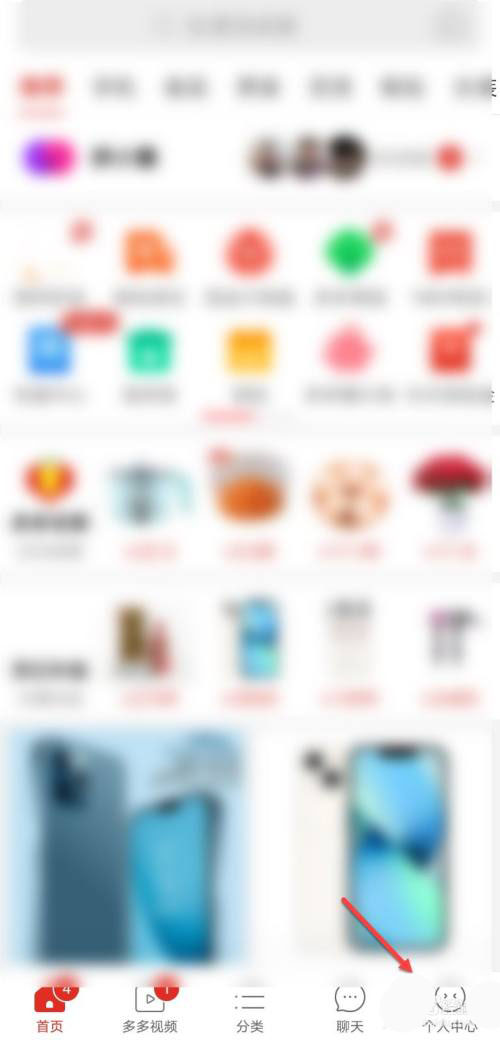

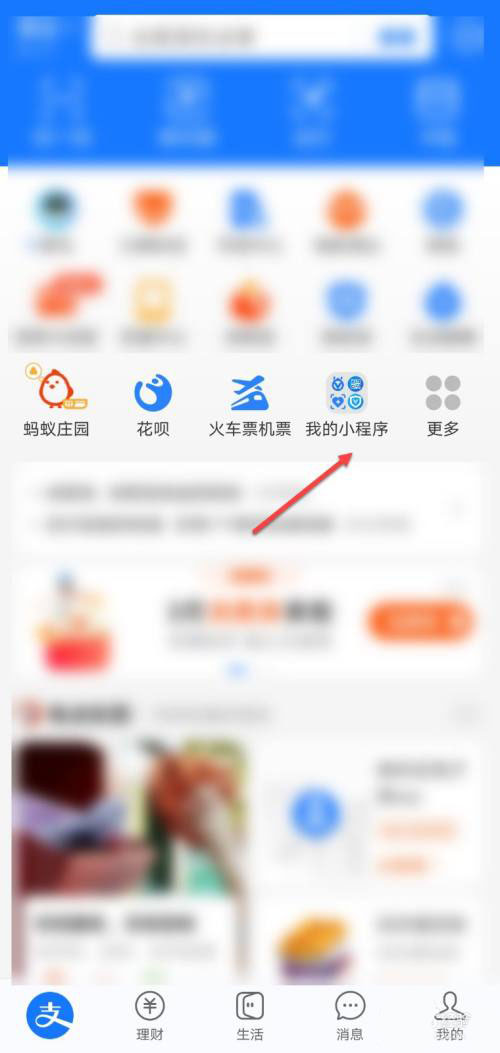

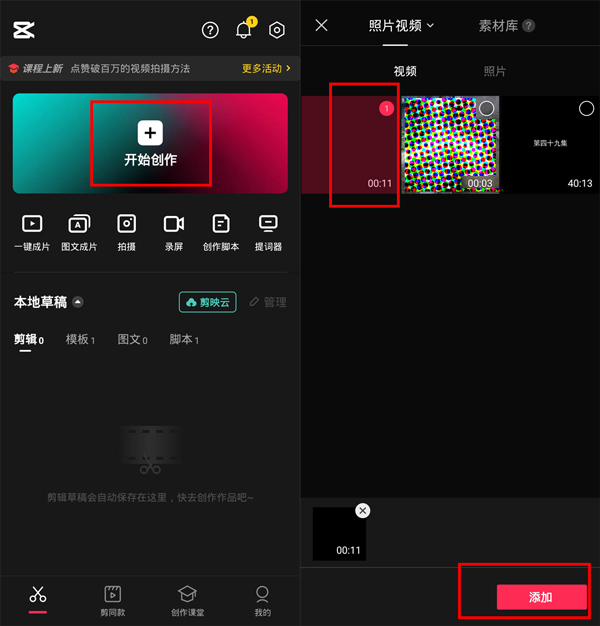

改了改了,他们都改了!据不完全统计,截至3月15日,抖音、今日头条、微信、淘宝、百度、大众点评、微博、小红书等App均已上线算法关闭键,允许用户在后台一键关闭“个性化推荐”。在“3·15”国际消费者权益日到来之际,个人隐私保护跨出一大步、消费者权益得以保障,令人欣慰。

近几年,不少App打着“千人千面”的口号,基于算法为用户提供精准推送。市场也很认可这种商业模式,谁把用户的心思猜得准,谁的广告就赚得多。但App们极少主动提示“千人千面”会大规模收集和使用用户个人信息,更不会冒着断自己财路的风险,设计算法关闭键。

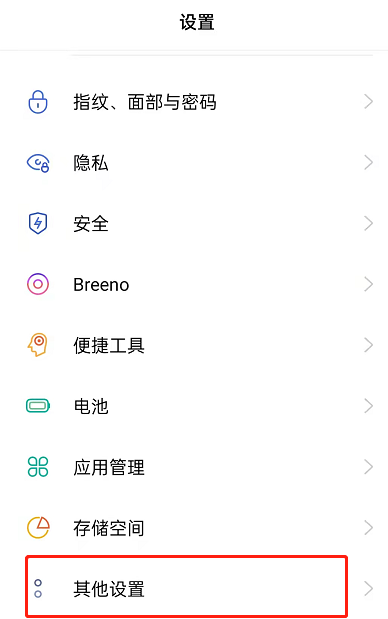

直到今年1月,《互联网信息服务算法推荐管理规定》出台,明确了算法推荐服务提供者应当以显著方式告知用户其提供算法推荐服务的情况;向用户提供不针对其个人特征的选项,或者向用户提供便捷的关闭算法推荐服务的选项。该规定自3月1日起施行,App们不想改也不行了。

个性化推荐有助于改善用户体验。用户不管是喜欢小动物、美食还是美妆,都不用到处去搜索资源,算法会源源不断地推荐。不太美好的一面在于,算法很了解用户,但用户对算法几乎一无所知;算法强大到能控制用户的眼睛,甚至基于算法实施“大数据杀熟”,但用户对此几乎无计可施。

北京大学互联网发展研究中心发布的《中国大安全感知报告(2021)》显示,受访者中,60%担心自己的信息在数字环境中有泄露风险,70%担心个人喜好、兴趣被算法“算计”,50%表示在算法束缚下想要逃离网络、远离手机。这意味着算法构建的不只是“信息茧房”,还可能是“信息囚笼”,用户明知不妥又挣不脱。算法新规就是要求App们给笼门配一把钥匙,并交到用户手中。

目前大部分App都把算法关闭键埋得比较深,这点小心思可以理解。其实,“算法开关”不是自废武功,而是补地基上的漏洞,有利于合规企业进一步发挥优势。网络安全、数字安全是托起数字经济的底层逻辑,不能建立在侵害消费者知情权与选择权的基础上,企业对此心知肚明。有一个有意思的现象——按理说,以算法起家的字节跳动系应该最忌惮关闭算法,可偏偏它旗下产品设置的算法开关位置最显眼、分类最齐全。一方面,这说明企业对自己的服务有信心,相信消费者会自愿打开;另一方面,这也在一定程度上表明部分企业已经意识到数据收集越透明、越规范,对自己越是一种保护。

算法开关给了消费者选择权,还应进一步保障消费者知情权。算法不该是企业手里的“黑匣子”,而应是用户眼前的透明鱼缸。用户不用弄懂鱼缸的生态系统如何运转,但有权知道鱼缸里装了什么。这方面,微信、大众点评等App列出了“个人信息收集清单”,告诉消费者自己收集了哪些信息,以及如何使用这些信息。这种明确告知有必要成为行业共识。

设置算法开关只是保障数字安全的第一步。如果得到消费者信任,企业可以继续优化算法,推荐向上向善的内容,增强用户黏性;如果消费者选择关闭,企业也可以采用其他方式改善消费者体验,但要注意不能故意提供过时、低质信息逼消费者打开算法,实质上侵害消费者选择权。总之,消费者的心思可以猜,但猜的企业要合法合规,被猜的用户得心甘情愿。

营业执照公示信息

营业执照公示信息